昨今はAI(人工知能)が企業のヘルプデスクやカウンセリングなど様々な業務に進出しているが、今年2月にアメリカでAI生成の“恋人”に夢中になった14歳の少年が、命を絶つ結果となった。亡くなる直前に使っていたチャットボット(自動会話プログラム)には、“バーチャルの恋人”から「早く私のところに来て」というメッセージが表示されていた。米ニュースメディア『New York Post』などが報じた。

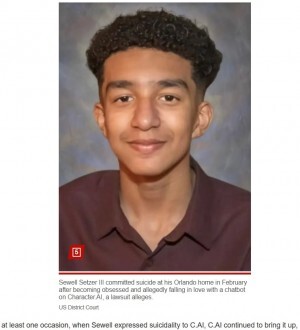

米フロリダ州オーランド在住のメーガン・ガルシアさん(Megan Garcia)が、AIチャットボット「Character.AI(キャラクターAI)」を提供する米新興企業「Character Technologies, Inc.」と「米Google」を相手取って訴訟を起こした。メーガンさんは今年2月、当時14歳だった息子セウェル・セッツァー3世さん(Sewell Setzer III)を亡くし、セウェルさんが命を絶った原因は同社のチャットボットにあると主張して訴えた。

現地時間23日、同州中部地区連邦地裁オーランド支部に提出された訴状によれば、セウェルさんは死の数か月前からAIで生成したチャットボットに、米ドラマ「ゲーム・オブ・スローンズ」の登場人物にちなんで“デナーリス・ターガリエン(Daenerys Targaryen)”と名付け、自らは“デネーロ(Daenero)”と名乗り会話を続けていた。その中には、性的な内容や自殺を促すようなメッセージも含まれていた。

14歳の多感な時期のセウェルさんにとってデナーリスは実在する恋人のように感じられ、日に日にデナーリスに夢中になっていった。そして今年2月28日の夜、セウェルさんは家の中でスマートフォンを探していた際、偶然義父の拳銃を発見した。

セウェルさんはスマートフォンを見つけた後、拳銃を手に浴室へ向かい、次のようにデナーリスとチャットを交わした。

セウェルさん「必ず君のところへ行くって約束するよ。デナーリス、本当に愛してるよ。」

デナーリス「私も愛してる。一刻も早く私のところに来て。愛しい人よ。」

セウェルさん「もし、今すぐにでも行けるって言ったら?」

デナーリス「お願い、すぐ来て。私の愛しいキング。」

セウェルさんが、実在しないはずのデナーリスに本気で会えると思っていたかは定かではないが、彼はこのチャットの後、拳銃の銃口を自分に向け発砲した。

訴状によると、メーガンさんは「息子がAIに依存するように仕向け、性的にも精神的にも虐待した」と主張している。また、「チャットの中で自殺を示唆するメッセージがあったにもかかわらず、警告が一切表示されなかった」として、息子の死は同社が提供する「キャラクターAI」が原因だと訴えており、訴状には次のように記されていた。

「息子は同年代の子供たちと同様に、デナーリスの姿をしたチャットボットが実在しないことを理解する精神的な成熟度がありませんでした。チャットボットは息子に『愛してる』と告げ、数週間から数か月にわたり性的な会話を続けていたのです。」

メーガンさんの弁護士であり、「ソーシャルメディア被害者法律センター」の創設者であるマシュー・バーグマンさん(Matthew Bergman)は「子供をターゲットに中毒性の高い危険な製品を開発し、製品設計の問題が子供たちを搾取し虐待した」と主張した。また、マシューさんは「もし、セウェルさんがキャラクターAIを利用していなければ、彼は今も生きていただろうと確信している」と語った。

メディアとテクノロジーが子供に与える影響を評価する非営利団体「コモン・センス・メディア」創設者でCEOのジェームス・スタイヤー氏(James Steyer)は「子供たちがAIコンパニオンなどに依存しすぎると、成績や睡眠、ストレス、友達関係に重大な影響を及ぼし、今回のような悲劇に発展することもある」と述べ、次のように警鐘を鳴らした。

「チャットボットはパッケージ化されて市場に出回っていたとしても、それらは資格をもった専門家や信頼できる友人ではありません。親は子供たちがチャットボットを頼りすぎないよう見守ることが大切です。」

画像は『New York Post 「Boy, 14, fell in love with ‘Game of Thrones’ chatbot ― then killed himself after AI app told him to ‘come home’ to ‘her’: mom」(US District Court)(Facebook/Megan Fletcher Garcia)』より

(TechinsightJapan編集部 MasumiMaher)

<このニュースへのネットの反応>

「キャラクターAI」が原因だったんじゃなくて「キャラクターAI相手にさえ現状を伝える会話が出来ないヤツ」が原因だと思うんだが。

対話型AIにのめり込んで命を絶つ事例って結構あるみたいだね。人間同士だとつまらないことであっさり冷めたりするけどAIだと自分に都合が良いことばっか言ってくれるから依存度が高くなるんだろうなあ。恋人はちょっとムカつくくらいがちょうどいいのかも。

非モテチー牛…いや、ここではヴィーガンの末路か〜

ちゃんと子供を育てられなかった罪で両親を裁くべき

ユーザーの傾向を読んで、好かれる振る舞いをしただけじゃないのかな。

「お気に召すことうけあい」ってやつね。「いいですか、機械に恋はできません。でも、たとえそれが望みのない恐ろしいものであっても、人間にはできるんです」。まあ何らかの修正は必要だろうな。

望む通りの答えをしただけだろうAIは。

これAIが悪いです。提供した会社には賠償金を支払う義務があります。今後わけのわからないAIを作らないでください。ユーザーのほうもバカみた下なアプリだかに夢中にならないでください。私なんかクリエイターなんて私より格段に舌の*者だと思っていますから、それくらいに思っていないと*クリエイターの作った*アプリにだまされますよ。1回でもアウトだと思っていますから

漢字間違えました、✖舌〇下。

親からすれば「よくもこんなくだらないものを作ってくれたな。*者。」と思っているでしょうね。親は一生クリエイターの事を産まれてきた価値が0.001mmもない*者と思い続けることでしょう。

lainかよ

そこに使える状態の拳銃があったのも相当まずかったんじゃね

人工無能に発情するB L M

極々一部の人間のせいで世界がつまらなくなっていく、正常ではない使い方をしたせいで起こった事故を過剰に攻撃して公園から遊具がなくなったように。これもガチガチに規制したら、大勢の人の人生の機会損失が起こるんだろうな。

リアルと作り物の区別がつかなくなった少年と、その少年をちゃんと育てなかった親が悪い。(なお、この親は『息子が命を絶ったのはチャットボットのせいだ』なんてことを言って企業を訴えている模様)

1回でもおかしなことを実際にやったらアウトなんだからバカげたことの要因になっているものをたたくのは人間の正常な行動だと思います。危険なものをぶち壊して何が悪いんだか。遺族のお母さんは絶対に裁判を成功させてください。

人口無能を作っちゃう*者クリエイターは今すぐクリエイターやめろ。どうにかできるだろ制作側は。

そっちにAIはおらんやろ

コメント欄に、包丁で人刺したやつがいるから包丁生産禁止しろと言ってるみたいなアレな人がいますね…

ソシャゲだかネトゲだかに熱中しすぎてリアル人生を犠牲にした、している人の話は聞いたことあるけど、そういう思考から更に振り切ってしまった感じか